MainPage/Algorithm&DataStructures/Lecture

- Lecture 1

- Lecture 5-6 Модели безопасности

- 12.1. Модели разграничения доступа

- 12.2. Модели дискреционного доступа

- 12.3. Модели мандатного доступа

- 12.4. Специализированные модели

- 12.5. Проблемы моделей предоставления прав 权利模型的问题

- 12.6. Информационные модели

- 12.7. Вероятностные модели

- 12.8 .Модели контроля целостности 完整性控制模型

- 12.9. Механизмы защиты от угрозы отказа в обслуживании

- Lecture 9

Lecture 1

Ретроспективный анализ подходов к формированию множества угроз информации

各种信息威胁形成途径的回顾性分析

Вопрос об угрозах информации возник практически одновременно с началом регулярного сбора, обработки и использования информации. Известно, что шифрование информации в целях сохранения ее тайны применял еще древнеримский диктатор Цезарь. За столетия развития традиционных (бумажных) технологий выработана весьма стройная и высокоэффективная система выявления и нейтрализации угроз.

Особую актуальность и новое содержание проблемы формирования множества угроз приобрела в 60-е - 70-е годы нашего столетия в связи с регулярным использованием для обработки и хранения информации средств электронно-вычислительной техники. При этом раньше других интерес был проявлен к угрозам физической целостности информации, поскольку другие виды угроз были менее актуальны. (Например, угроза несанкционированного получения информации в значительной мере нейтрализовывалась ограничениями на автоматизированную обработку секретных данных). Но по мере расширения сфер и масштабов использования вычислительной техники проблемы предупреждения несанкционированного получения закрытой информации приобретали все большую остроту, в связи с чем росла и актуальность задачи выявления соответствующих угроз.

При обработке информации средствами электронно-вычислительной техники (ЭВТ) возникает большое количество угроз как прямого несанкционированного доступа к защищаемой информации, так и косвенного ее получения средствами технической разведки.

Известно пять групп основных угроз: хищение носителей, запоминание или копирование информации, несанкционированное подключение к аппаратуре, несанкционированный доступ к ресурсам ЭВТ, перехват побочных излучений и наводок.

В некоторых источниках предпринята попытка классификации угроз, причем в качестве критерия классификации принят тип средств, с помощью которого может быть осуществлено несанкционированное получение информации. Выделено три типа средств: человек, аппаратура и программа. В группе угроз, в реализации которых основную роль играет человек, названы: хищение носителей, чтение информации с экрана, чтение информации с распечаток; в группе, где основным средством выступает аппаратура подключение к устройствам и перехват излучений; в группе, где основное средство программа — несанкционированный программный доступ, программное дешифрование зашифрованных данных, программное копирование информации с носителей.

Также, угрозы могут быть классифицированы по возможному их источнику; причем выделено три класса: природные (стихийные бедствия, магнитные бури, радиоактивное излучение и наводки); технические (отключение или колебания электропитания, отказы и сбои аппаратно-программных средств, электромагнитные излучения и наводки, утечки через каналы связи); созданные людьми, причем различаются непреднамеренные и преднамеренные действия различных категорий лиц.

В руководящем документе Гостехкомиссии России (сейчас ФСТЭК) введено понятие модели нарушителя в автоматизированной системе (АС), причем в качестве нарушителя рассматривается субъект, имеющий доступ к работе со штатными средствами АС. Нарушители классифицируются по уровню возможностей, предоставляемых им штатными средствами, причем выделяются четыре уровня этих возможностей:

- первый — возможности запуска задач (программ) из фиксированного набора, реализующих заранее предусмотренные функции обработки информации;

- второй — дополнительно к предыдущему предусматривает возможности создания и запуска собственных программ с новыми функциями обработки информации;

- третий — дополнительно к предыдущему предполагает возможности управления функционированием АС, т.е. воздействия на базовое программное обеспечение системы и на состав и конфигурацию ее оборудования);

- четвертый — определяется всем объемом возможностей лиц, осуществляющих проектирование, реализацию и ремонт технических средств АС, вплоть до включения в состав средств системы собственных технических средств с новыми функциями обработки информации.

Предполагается, что нарушитель на своем уровне является специалистом высшей квалификации, знает все об АС, в том числе и о средствах защиты.

Своеобразный вид угроз представляют специальные программы, скрытно и преднамеренно внедряемые в различные функциональные программные системы и которые после одного или нескольких запусков разрушают хранящуюся в них информацию и/или совершают другие недозволенные действия. К настоящему времени известно несколько разновидностей таких программ: электронные вирусы, компьютерные черви, троянские кони.

Электронные вирусы — это такие вредоносные программы, которые не только осуществляют несанкционированные действия, но обладают способностью к саморазмножению, в силу чего представляют особую опасность дня электронно-вычислительных сетей. Однако, для размножения им необходим носитель (файл, диск), что, естественно, создает для злоумышленников определенные трудности в осуществлении их несанкционированных действий.

Троянскими конями названы такие вредоносные программы, которые злоумышленно вводятся в состав программного обеспечения и в процессе обработки информации осуществляют несанкционированные процедуры, чаще всего - процедуры незаконного захвата защищаемой информации, например, записывая ее в определенные места ЗУ или выдавая злоумышленникам.

К компьютерным червям отнесены вредоносные программы, подобные по своему воздействию электронным вирусам, но не требующие для своего размножения специального носителя. Они обычно используют дополнительный вход в операционную систему, который создается для удобства ее отладки и который нередко забывают убрать по окончанию отладки.

Раньше других появились и использовались в злоумышленных целях троянские кони, сведения о них относятся еще к семидесятым годам, причем наиболее распространенной несанкционированной процедурой было считывание информации с областей ЗУ, выделяемых законным пользователям. Первое сообщение о возможности создания электронных вирусов было сделано в 1984 г. на одной из конференций по безопасности информации, а уже в 1985 г. была осуществлена вирусная атака на компьютерную систему подсчета голосов в конгрессе США, вследствие чего она вышла из строя. В 1987 г. зафиксированы факты появления вирусов в нашей стране.

О возможных последствиях таких угроз мощно судить по следующему примеру. Адъюнкт Корнельского университета США 25-летний Роберт Моррис (кстати, сын сотрудника Агентства национальной безопасности США) 2 ноября 1988 г. произвел вирусную атаку на национальную сеть Milnet/Arpanet и международную компьютерную сеть Internet, в результате чего было выведено из строя около 6000 компьютеров. Вирус был введен в один из узлов сети, затем он разослал свои копии (длина 99 строк на языке Си), в другие узлы. В узле-получателе копия копировалась и выполнялась. В процессе выполнения с узла-источника копировалось остальное тело вируса. Общий размер вируса составил около 60 Кбайт. Хотя вирус не производил действий по разрушению или модификации информации, а способы ликвидации его были найдены уже на второй день, ущерб от его действия оценивался более чем в 150 тысяч долларов. Исследовательскому же центру НАСА в г. Маунтинн Вью (Калифорния) пришлось на два дня закрыть свою сеть для восстановления нормального обслуживания 52000 пользователей.

Уже такого беглого взгляда на вредоносные программы достаточно, чтобы убедиться в большой опасности их как угроз информации в современных средствах ЭВТ.

2.4. Цели и задачи оценки угроз информации в современных системах ее обработки

Оценка угроз заключается в определении значений тех показателей, которые необходимы для решения всех задач, связанных с построением и эксплуатацией механизмов защиты информации. Тогда общую задачу оценки угроз можно представить совокупностью следующих составных частей:

- обоснование структуры и содержания системы показателей, необходимых для исследований и практического решения всех задач, связанных с защитой информации;

- обоснование структуры и содержания тех параметров, которые оказывают существенное влияние на значения показателей уязвимости информации;

- разработка комплексов моделей, отображающих функциональные зависимости показателей от параметров и позволяющих определять значения всех необходимых показателей уязвимости информации во всех представляющих интерес состояниях и условиях жизнедеятельности СОД;

- разработка методологии использования моделей определения значений показателей уязвимости при исследованиях и практическом решении различных вопросов защиты, или иначе — разработка методологии оценки уязвимости информации.

В следующих параграфах данной главы излагаются методы подхода к решению перечисленных составных задач.

2.5. Система показателей уязвимости информации

Для системной оценки уязвимости информации в системе обработки данных (СОД) необходима система показателей, которая отражала бы все требования к защите информации, а также структуру СОД, технологию и условия автоматизированной обработки информации.

Уязвимость информации необходимо оценивать в процессах: разработки и внедрения СОД, функционирования СОД на технологических участках автоматизированной обработки информации, функционирования СОД независимо от процессов обработки информации. Уязвимость информации в процессе разработки и внедрения СОД обуславливается уязвимостью создаваемых компонентов системы и создаваемых баз данных.

Особое значение на данной стадии имеет минимизация уязвимости программного обеспечения, поскольку от этого существенно зависит общая уязвимость информации в СОД.

Условия автоматизированной обработки информации характеризуются главным образом совокупностью следующих параметров:

- структурой СОД, чем определяется состав, подлежащих защите объектов и элементов; наличием и количеством угроз, потенциально возможных в структурных компонентах СОД;

- количеством и категориями лиц, которые могут быть потенциальными нарушителями статуса защищаемой информации; режимами автоматизированной обработки информации.

Уязвимость информации в процессе функционирования СОД независимо от процесса обработки информации обуславливается тем, что современные СОД представляют собою организационную структуру с высокой концентрацией информации, которая может быть объектом случайных или злоумышленных воздействий даже в том случае, если автоматизированная обработка ее не осуществляется.

Поскольку воздействие на информацию различных факторов в значительной мере является случайным, то в качестве количественной меры уязвимости информации наиболее целесообразно принять вероятность нарушения защищаемых характеристик ее при тех условиях сбора, обработки и хранения, которые имеют место в СОД, а также потенциально возможные размеры (математическое ожидание) нарушения защищенности информации.

Основными параметрами, определяющими вероятность нарушения защищенности информации, являются:

- количество и типы тех структурных компонентов СОД, в которых оценивается уязвимость информации;

- количество и типы случайных угроз, которые потенциально могут проявиться и оказать негативное воздействие на защищаемую информацию;

- количество и типы злоумышленных угроз, которые могут иметь место и оказать воздействие на информацию;

- число и категории лиц, которые потенциально могут быть нарушителями правил обработки защищаемой информации; виды защищаемой информации.

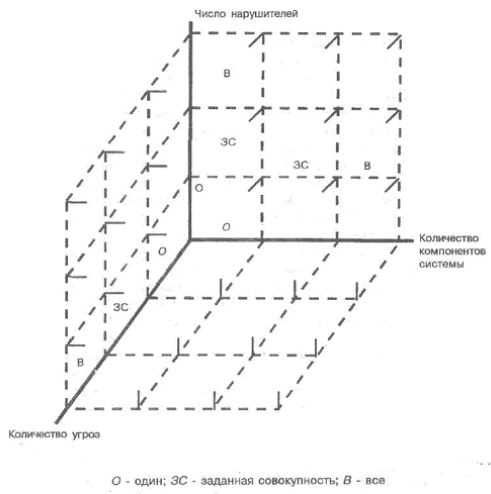

Множество разновидностей различных показателей уязвимости определяется декартовым произведением чисел, характеризующих количество значений всех значащих параметров. Если не разделять угрозы на случайные и злоумышленные (т.е. рассматривать их единым множеством) и не разделять защищаемую информацию на виды, то структура полного множества разновидностей показателей уязвимости может быть наглядно представлена так, как показано на рис. 2.4, из которого следует, что два показателя занимают особое положение, а именно: первый находится в самом начале выбранной системы координат, второй — в самом конце классификационной структуры, т.е. занимает крайнее положение справа, вверху и спереди.

Первый показатель обозначает уязвимость информации в одном структурном компоненте СОД при однократном проявлении одной угрозы и относительно одного потенциального нарушителя. Все другие показатели приведенного на рисунке множества могут быть выражены в виде некоторой функции этого показателя. Второй выделенный выше показатель характеризует общую уязвимость, т.е. уязвимость информации в СОД в целом по всем потенциально возможным угрозам относительно всех потенциально возможных нарушителей. Первый показатель назовем базовым, второй — общим. Тогда другие показатели приведенного на рис. 2.4. множества можно назвать частично обобщенными.

Однако для исследования и практического решения задач зашиты информации наряду с рассмотренными выше необходимы еще такие показатели, которые характеризуют наиболее неблагоприятные ситуации с точки зрения уязвимости информации. Такими являются: самый уязвимый структурный компонент АСОД, самая опасная угроза, самый опасный нарушитель. Эти показатели могут быть названы экстремальными.

2.6. Классификация и содержание угроз информации

Одной из наиболее принципиальных особенностей проблемы защиты информации является абсолютный характер для обеспечения возможностей реализации упреждающей стратегии зашить требования полноты всех угроз информации, потенциально возможных в современных СОД. Даже одна неучтенная (невыявленная или непринятая все внимание) угроза может в значительной мере снизить эффективность защиты. В то же время проблема формирования полного множеств угроз относится к числу ярко выраженных неформализованных проблем. Обусловлено это тем, что архитектура современны средств автоматизированной обработки информации, организационное структурное функциональное построение информационно-вычислительных систем и сетей, технология и условия автоматизированной обработки информации такие, что накапливаемая, хранимая и обрабатываемая информация подвержена случайным влияниям чрезвычайно большого числа факторов многие из которых должны быть квалифицированы как дестабилизирующие. Убедительным доказательством справедливости утверждения о неформализуемости задачи формирования полного множества угроз может служить тот факт, что в имеющихся достаточно многочисленных публикациях по проблемам защиты информации обсуждаемая задача практически даже не поставлена.

Таким образом, возникает ситуация, когда, с одной стороны, требование необходимости решения задачи является абсолютным, а с другой, регулярные методы решения этой задачи отсутствуют. Рассмотрим возможные подходы разрешения данного противоречия.

Одним из наиболее адекватных и эффективных методов формирования и особенно проверки множества потенциально возможных угроз является метод натурных экспериментов. Суть его заключается в том, что на существующих СОД проводятся специальные эксперименты, в процессе которых выявляются и фиксируются проявления различных дестабилизирующих факторов. При надлежащей организации экспериментов и достаточной их продолжительности можно набрать статистические данные, достаточные для обоснованного решения рассматриваемой задачи. Однако постановка таких экспериментов будет чрезвычайно дорогостоящей и сопряжена с большими затратами сил и времени. Поэтому данный метод целесообразен не для первоначального формирования множества угроз, а для его уточнения и дополнения, осуществляемого попутно с целевым функционированием СОД.

Таким образом, возникает ситуация, когда, с одной стороны, требование необходимости решения задачи является абсолютным, а с другой, регулярные методы решения этой задачи отсутствуют. Рассмотрим возможные подходы разрешения данного противоречия.

Одним из наиболее адекватных и эффективных методов формирования и особенно проверки множества потенциально возможных угроз является метод натурных экспериментов. Суть его заключается в том, что на существующих СОД проводятся специальные эксперименты, в процессе которых выявляются и фиксируются проявления различных дестабилизирующих факторов. При надлежащей организации экспериментов и достаточной их продолжительности можно набрать статистические данные, достаточные для обоснованного решения рассматриваемой задачи. Однако постановка таких экспериментов будет чрезвычайно дорогостоящей и сопряжена с большими затратами сил и времени. Поэтому данный метод целесообразен не для первоначального формирования множества угроз, а для его уточнения и дополнения, осуществляемого попутно с целевым функционированием СОД.

Для первоначального формирования возможно более полного множества угроз наиболее целесообразно использовать экспертные оценки в различных их модификациях. Однако при этом не может быть гарантировано формирование строго полного их множества. Поэтому будем называть формируемое таким образом множество относительно полным, подчеркивая этим самым его полноту относительно возможностей экспертных методов.

В соответствии с рассмотренной там методикой проводились работы по формированию относительно полных множеств угроз различного вида.

Для примера рассмотрим далее структуру и содержание относительно полного множества каналов несанкционированного получения информации КНПИ). Под КНПИ понимаются такие угрозы, следствием проявления которых может быть получение (или опасность получения) защищаемой информации лицами или процессами, не имеющими на это законных полномочий.

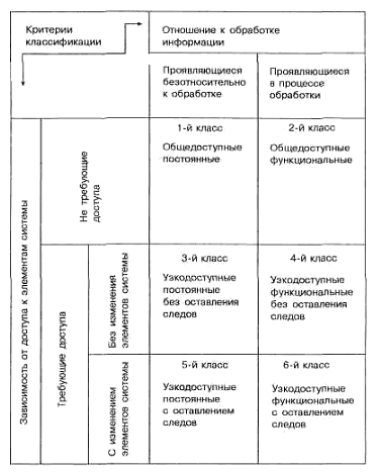

Прежде всего было установлено, что с целью формирования возможно более полного множества КНПИ необходимо построить строго полную классификационную их структуру. Такая структура может быть построена, если в качестве критериев классификации выбрать следующие два показателя:

- отношение к состоянию защищаемой информации в СОД;

- степень взаимодействия злоумышленника с элементами СОД.

По первому критерию будем различать два состояния: безотносительно к обработке (несанкционированное получение информации может иметь место даже в том случае, если она не обрабатывается, а просто хранится в СОД) и в процессе непосредственной обработки средствами СОД.

Полная структуризация второго критерия может быть осуществлена выделением следующих его значений:

- без доступа к элементам СОД (т.е. косвенное получение информации);

- с доступом к элементам СОД, но без изменения их состояния или содержания;

- с доступом к элементам СОД и с изменением их содержания или состояния. Классификационная структура КНПИ представлена на рис.2.5.

Полнота представленной классификационной структуры гарантируется тем, что выбранные критерии классификации охватывают все потенциально возможные варианты взаимодействия злоумышленника с АСОД, а структуризация значений критериев осуществлялась по методу деления целого на части.

Таким образом, все множество потенциально возможных КНПИ может быть строго разделено на шесть классов; содержание и обозначение выделенных классов приведены на рис. 2.5.

Следующим шагом на пути решения рассматриваемой задачи является обоснование возможно более полного перечня КНПИ в пределах каждого из шести классов. Эта работа выполнялась преимущественно эвристическими методами, в силу чего полнота полученных перечней не может быть гарантирована. Поэтому сформированное множество КНПИ является полным лишь относительно, т.е. лишь относительно имеющей степени познания природы появления каналов.

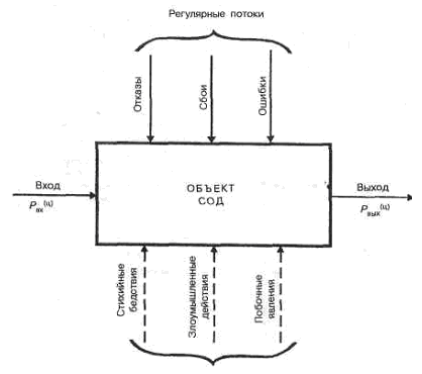

Уязвимость информации, т.е. нарушение установленного статуса и требуемого уровня ее защищенности есть событие, возникающее как результат такого стечения обстоятельств, когда в силу каких-то причин используемые в СОД средства защиты не в состоянии оказать достаточного противодействия проявлению угроз нежелательного их воздействия на защищаемую информацию. Модель уязвимости информации в СОД в самом общем виде представлена на рис. 2.6.

Приведенная модель детализируется при изучении конкретных видов уязвимости информации: нарушения целостности, несанкционированной модификации, несанкционированного получения, несанкционированного размножения.

При детализации общей модели основное внимание акцентируется на то обстоятельство, что подавляющее большинство нарушений целостности информации осуществляется в процессе ее обработки на различных участках технологических маршрутов. При этом целостность информации в каждом объекте СОД существенно зависит не только от процессов, происходящих на объекте, но и от целостности информации, поступающей на его вход.

Основную опасность представляют случайные дестабилизирующие факторы (отказы, сбои и ошибки компонентов СОД), которые потенциально могут проявиться в любое время, и в этом отношении можно говорить о регулярном потоке этих факторов. Из стихийных бедствий наибольшую опасность представляют пожары, опасность которых в большей или меньшей степени также является постоянной. Опасность побочных явлений практически может быть сведена к нулю путем надлежащего выбора места для помещений СОД и их оборудования. Что касается злоумышленных действий, то они связаны главным образом с несанкционированным доступом к ресурсам СОД. При этом наибольшую опасность представляет занесение вирусов.

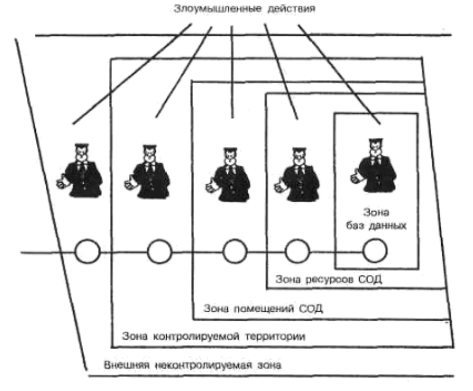

С точки зрения несанкционированного получения информации принципиально важным является то обстоятельство, что в современных СОД несанкционированное получение информации возможно не только путем непосредственного доступа к базам данных, но и многими путями, не требующими такого доступа. При этом основную опасность представляют злоумышленные действия людей. Воздействие случайных факторов само по себе не ведет к несанкционированному получение информации, оно лишь способствует появлению; КНПИ, которыми может воспользоваться злоумышленник. Структурированная схема потенциально возможных злоумышленных действий в современных СОД для самого общего случая представлена на рис. 2.7.

Выделенные на рисунке зоны характеризуются следующим образом:

- внешняя неконтролируемая зона — территория вокруг СОД, на которой персоналом и средствами СОД не применяются никакие средства и не осуществляются никакие мероприятия для защиты информации;

- зона контролируемой территории — территория вокруг помещений СОД, которая .непрерывно контролируется персоналом или средствами СОД;

- зона помещений СОД — внутреннее пространство тех помещений, в которых расположены средства системы:

- зона ресурсов СОД — та часть помещений, откуда возможен непосредственный доступ к ресурсам системы;

- зона баз данных — та часть ресурсов системы, с которых возможен непосредственный доступ к защищаемым данным.

Злоумышленные действия с целью несанкционированного получения информации в общем случае возможны в каждой из перечисленных зон. При этом для несанкционированного получения информации необходимо одновременное наступление следующих событий:

- нарушитель должен получить доступ в соответствующую зону;

- во время нахождения нарушителя в зоне в ней должен проявиться (иметь место) соответствующий КНПИ;

- соответствующий КНПИ должен быть доступен нарушителю соответствующей категории;

- в КНПИ в момент доступа к нему нарушителя должна находиться защищаемая информация.

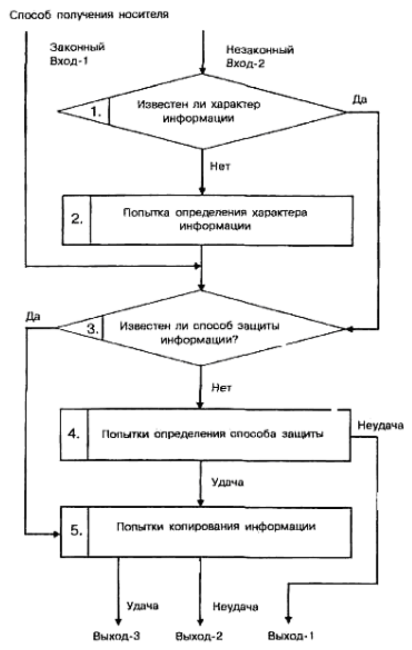

Рассмотрим далее трансформацию общей модели уязвимости с точки зрения несанкционированного копирования информации. Принципиальными особенностями этого процесса являются следующие:

- любое несанкционированное копирование есть злоумышленное действие;

- несанкционированное копирование может осуществляться в организациях-разработчиках компонентов СОД, непосредственно в СОД и сторонних организациях, причем последние могут получать носитель, с которого делается попытка снять копию как законным, так и незаконным путем.

Попытки несанкционированного копирования информации у разработчика и в СОД есть один из видов злоумышленных действий с целью несанкционированного ее получения и поэтому имитируются приведенной выше (см. рис. 2.7.) моделью. Если же носитель с защищаемой информацией каким-либо путем (законным или незаконным) попал в стороннюю организацию, то для его несанкционированного копирования могут использоваться любые средства и методы, включая и такие, которые носят характер научных исследований и опытно-конструкторских разработок. Тогда модель процесса размножения в самом общем виде может быть представлена так, как показано на рис. 2.8.

Для определения значений показателей уязвимости информации должны быть разработаны методы, соответствующие природе этих показателей и учитывающие все факторы, влияющие на их значение. На основе этих методов должны быть разработаны модели, позволяющие рассчитывать значения любой совокупности необходимых показателей и при любых вариантах архитектурного построения СОД, технологии и условий ее функционирования.

В процессе развития теории и практики защиты информации сформировалось три методологических подхода к оценке уязвимости информации: эмпирический, теоретический и теоретико-эмпирический.

Сущность эмпирического подхода заключается в том, что на основе длительного сбора и обработки данных о реальных проявлениях угроз информации и о размерах того ущерба, который при этом имел место, чисто эмпирическим путем устанавливаются зависимости между потенциально возможным ущербом и коэффициентами, характеризующими частоту проявления соответствующей угрозы и значения имевшего при ее проявлении размера ущерба. Наиболее характерным примером моделей рассматриваемой разновидности являются модели, разработанные специалистами американской фирмы IBM.

Теоретический подход основывается на знании законов распределения всех случайных величин, характеризующих процессы защиты, и построении на этой основе строгих зависимостей.

Теоретико-эмпирический подход основывается на житейски-естественном представлении процессов негативного воздействия на информацию и выражении этих процессов с использованием основных положений теории вероятностей.

Lecture 5-6 Модели безопасности

В настоящей главе модели рассматриваются в соответствии с типом угроз, от которых защищают информацию вычислительные системы, синтезированные на основании данных моделей.

12.1. Модели разграничения доступа

Модели разграничения доступа служат для синтеза политик безопасности, направленных на предотвращение угрозы раскрытия, заключающейся в том, что информация становится известной тому, кому не следовало бы ее знать. Данные модели могут быть классифицированы следующим образом:

- модели разграничения доступа, построенные по принципу предоставления прав;

- модели разграничения доступа, построенные на основе принципов теории информации;

- модели разграничения доступа, использующие принципы теории вероятностей.

В дальнейших пунктах мы рассмотрим модели разграничения доступа, построенные на основании перечисленных выше принципов.

12.2. Модели дискреционного доступа

Модели разграничения доступа, построенные по принципу предоставления прав, являются самой естественной основой для построения политик разграничения доступа. Система, политика безопасности которой построена на основании данного принципа, впервые была описана в литературе в середине шестидесятых годов.

Неформально право доступа может быть описано как “билет”, в том смысле, что владение “билетом” разрешает доступ к некоторому объекту, описанному в билете.

Основными типами моделей, построенных на предоставлении прав, являются модели дискреционного и мандатного доступов. Модели данного типа используются в большинстве реальных систем, синтезированных в настоящее время. Требования, на которых основаны данные модели, лежат в основе требований, сформулированных в различных государственных нормативных документах.

12.2.1. Модель дискреционного доступа АДЕПТ-50.

Одна из первых моделей безопасности была модель дискреционного доступа, модель АДЕПТ-50 [Ошибка! Источник ссылки не найден.,Ошибка! Источник ссылки не найден.]. В модели представлено четыре типа объектов, относящихся к безопасности: пользователи(u), задания(j), терминалы(t) и файлы(f), причем каждый объект описывается четырехмерным кортежем (A, C, F, M), включающим параметры безопасности:

Компетенция A – скаляр – элементы из набора иерархически упорядоченных уровней безопасности, таких как НЕСЕКРЕТНО, КОНФИДЕНЦИАЛЬНО, СЕКРЕТНО, СОВЕРШЕННО СЕКРЕТНО.

Категория C – дискретный набор рубрик. Категории не зависят от уровня безопасности. Пример набора рубрик: ОГРАНИЧЕНО, ТАЙНО, ТОЛЬКО ДЛЯ ПРОСМОТРА, ЯДЕРНЫЙ, ПОЛИТИЧЕСКИЙ.

Полномочия F – группа пользователей, имеющих право на доступ к определенному объекту.

Режим М – набор видов доступа, разрешенных к определенному объекту или осуществляемых объектом. Пример: ЧИТАТЬ ДАННЫЕ, ПРИСОЕДИНЯТЬ ДАННЫЕ, ИСПОЛНИТЬ ПРОГРАММУ.

Если $U={u}$ обозначает набор всех пользователей, известных системе, а $F(i)$ - набор всех пользователей, имеющих право использовать объект $i$, то для модели формулируются следующие правила:

- Пользователь u получает доступ к системе $\Leftrightarrow u\in U$.

- Пользователь u получает доступ к терминалу $t\Leftrightarrow u\in F(t)$ (то есть в том и только в том случае, когда пользователь $u$ имеет право использовать терминал $t$).

-

Пользователь u получает доступ к файлу $j\Leftrightarrow A(j) \ge A(f), C(j)\supseteq C(f), M(j)\supseteq M(f)$ и $u\in F(f)$, то есть тогда и только тогда, когда выполняются условия:

- привилегии выполняемого задания шире привилегий файла или равны им;

- пользователь является членом $F(f)$.

Задавая параметры безопасности A, C, F, M, можно сформировать матрицу определения параметров безопасности (табл. 12.1.).

Четырехмерный кортеж безопасности, полученный на основе прав задания, а не прав пользователя, используется в модели для управления доступом. Данный подход обеспечивает однородный контроль права на доступ над неоднородным множеством программ и данных, файлов, пользователей и терминалов. Например, наивысшим полномочием доступа к файлу для пользователя “СОВ. СЕКРЕТНО”, выполняющего задание с “КОНФИДЕНЦИАЛЬНОГО” терминала будет “КОНФИДЕНЦИАЛЬНО”.

| Объект | A | C | F | M |

|---|---|---|---|---|

| Пользователь u | Const | Const | {u} | Const |

| Терминал t | Const | Const | {u(t,i)} | Const |

| Задание j | min(A(u),A(t)) | C(u)∩C(t) | {u(j,i)} | M(u)∩M(t) |

| Существ. файл f(i) | Const | Const | {u(f,i)} | Const |

| Нов. файл f=g(f1,f2) | max(A(f1),A(f2)) | C(f1)∪ C(f2) | {u(f,j)} | M(f1)∪ M(f2) |

Таблица 12.1 Матрица определения параметров безопасности модели АДЕПТ-50

– f1, f2 - старые файлы; новый файл f является некоторой их функцией.

12.2.2. Пятимерное пространство Хартсона

Теперь рассмотрим модель, называемую пятимерным пространством безопасности Хартстона [Ошибка! Источник ссылки не найден.]. В данной модели используется пятимерное пространство безопасности для моделирования процессов, установления полномочий и организации доступа на их основании. Модель имеет пять основных наборов:

А – установленных полномочий; U – пользователей; Е – операций; R – ресурсов; S – состояний.

Область безопасности будет выглядеть как декартово произведение: А×U×E×R×S. Доступ рассматривается как ряд запросов, осуществляемых пользователями u для выполнения операций e над ресурсами R в то время, когда система находится в состоянии s. Например, запрос на доступ представляется четырехмерным кортежем $q = (u, e, R, s), u\in U,e\in E,s\in S,r\subseteq R$. Величины u и s задаются системой в фиксированном виде. Таким образом, запрос на доступ – подпространство четырехмерной проекции пространства безопасности. Запросы получают право на доступ в том случае, когда они полностью заключены в соответствующие подпространства.

Процесс организации доступа можно описать алгоритмически следующим образом. Для запроса $q$, где $q (u, e, R, s)$, набора U’ вполне определенных групп пользователей, набора R’ вполне определенных единиц ресурсов и набора P правильных (установленных) полномочий процесс организации доступа будет состоять из следующих процедур:

- Вызвать все вспомогательные программы, необходимые для предварительного принятия решений.

- Определить из U те группы пользователей, к которым принадлежит u. Затем выбрать из P спецификации полномочий, которым соответствуют выделенные группы пользователей. Этот набор полномочий F(u) определяет привилегию пользователя u.

- Определить из P набор F(e) полномочий, которые устанавливают е как основную операцию. Этот набор называется привилегией операции е.

- Определить из P набор F(R) (привилегию единичного ресурса R) – полномочия, которые определяют поднабор ресурсов из R’, имеющего общие элементы с запрашиваемой единицей ресурса R.

Полномочия, которые являются общими для трех привилегий в процедурах 2, 3, 4, образуют D(q) (так называемый домен полномочий для запроса):

q: D(q)=F(u)∩F(e)F(R). - Удостовериться, что запрашиваемый ресурс R полностью включается в D(q), то есть каждый элемент из R должен содержаться в некоторой единице ресурса, которая определена в домене полномочий D(q).

- Осуществить разбиение набора D(q) на эквивалентные классы так, чтобы два полномочия попадали в эквивалентный класс тогда и только тогда, когда они специфицируют одну единицу ресурса. Для каждого такого класса логическая операция ИЛИ (или И) выполняется с условиями доступа элементов каждого класса.

Новый набор полномочий – один на каждую единицу ресурса, указанную в D(q), есть F(u, q) - фактическая привилегия пользователя u по отношению к запросу q.

- Вычислить ЕАС - условие фактического доступа, соответствующего запросу q, осуществляя логическое И (или ИЛИ) над условиями доступа членов F(u, q). Это И (или ИЛИ) выполняется над всеми единицами ресурсов, которые перекрывают единицу запрошенного ресурса.

- Оценить ЕАС и принять решение о доступе: − разрешить доступ к R, если R перекрывается; − отказать в доступе в противном случае.

- Произвести запись необходимых событий.

- Вызвать все программы, необходимые для организации доступа после “принятия решения”.

- Выполнить все вспомогательные программы, вытекающие для каждого случая из условия 8.

- Если решение о доступе было положительным – завершить физическую обработку.

Автор модели Хартстон отмечает, что приведенная последовательность шагов не всегда необходима в полном объеме. Например, в большинстве реализаций шаги 2 и 6 осуществляются во время регистрации пользователя в системе.

12.2.3. Модель Харрисона-Руззо-Ульмана

Рассмотрим типичную модель системы защиты, состоящую из следующих конечных наборов [Ошибка! Источник ссылки не найден.,Ошибка! Источник ссылки не найден.,Ошибка! Источник ссылки не найден.]:

- общих прав $A={a1,…, an}$;

- исходных субъектов S0 и объектов O0;

- команд С формы $\alpha(Х1, …, Хn)$ , где α - имя; Х1, …, Хn – формальные параметры, указывающие на объекты.

Элементами матрицы доступа являются права доступа, взятые из набора общих прав. Состояния системы изменяются при изменении элементов матрицы доступа M. Запросы к системе можно выразить в форме:

if a1 in M[s1, o1] and

a2 in M[s2,o2] and

am in M[sm,om] then

op1,

op2,

opn

Причем, $\forall a_j\in A$ операция op является одной из следующих примитивных операций:

enter a into (s, 0);delete a from (s, 0);create subject s;create object o;destroy subject o;destroy object o.

Семантика данных операций очевидна. Для системы с начальной конфигурацией $Q_0$ и права a можно сказать, что система безопасна для a, если не существует последовательности запросов к системе в состоянии $Q_0$ таких, что в результате них право a будет записано в ячейку, не содержащую ее. Существуют две теоремы о безопасности данного типа систем. Первая относится к безопасности моно-операционных систем. Под моно- операционной системой понимается система, в которой каждый запрос имеет только одну операцию.

Теорема 12.1. Существует алгоритм для определения, является или нет моно-операционная система безопасной для данного права a.

Вторая теорема указывает на то, что проблема безопасности для системы с запросами общего вида является неразрешимой.

Теорема 12.2. Проблема определения безопасности для данного права а в системе с запросами общего вида является неразрешимой.

Харрисон, Руззо и Ульман показали, что безопасными являются монотонные системы (системы, не содержащие операции destroy и delete), системы не содержащие операций create и моно-условные системы (системы, запрос к которым содержит только одно условие).

К достоинствам моделей дискреционного доступа можно отнести хорошую гранулированность защиты и относительно простую реализацию. В качестве примера реализаций данного типа моделей можно привести так называемую матрицу доступа, строки которой соответствуют субъектам системы, а столбцы – объектам; элементы матрицы характеризуют права доступа. Проблемы, возникающие в системах, синтезированных на их основании, показаны в следующем параграфе.

12.3. Модели мандатного доступа

Модели дискреционного доступа хотя и обеспечивают хорошо гранулированную защиту, но обладают рядом недостатков. В частности, в системах, построенных на основе DAC, существует проблема троянских программ (троянских коней). Троянскую программу следует определять как любую программу, от которой ожидается выполнение некоторого желаемого действия, а она на самом деле выполняет какое-либо неожиданное и нежелательное действие. Так, троянская программа может выглядеть как вполне хороший продукт, но реально она может оказаться даже более опасной, чем можно было бы ожидать.

Для того чтобы понять, как может работать троянский конь, вспомним, что когда пользователь вызывает какую–либо программу на компьютере, в системе инициируется некоторая последовательность операций, зачастую скрытых от пользователя. Эти операции обычно управляются операционной системой. Троянские программы рассчитывают на то, что когда пользователь инициирует такую последовательность, он обычно верит в то, что система произведет ее, как полагается. При этом нарушитель может написать версию троянской программы, которая будучи запущенной от имени пользователя– жертвы, передаст его информацию пользователю нарушителю.

В отличие от DAC, мандатный доступ (МАС) накладывает ограничения на передачу информации от одного пользователя другому. Это позволяет разрешить проблему троянских коней.

Классической моделью, лежащей в основе построения многих систем MAC и породившей остальные модели МАС, является модель Белла и Лападула. К сожалению, данная модель не лишена недостатков и с целью устранения данных недостатков были порождены некоторые специфичные модели. В заключении параграфа мы опишем специализированные модели, основанные на рассмотрении конкретных требований, в соответствии с которыми синтезируется данная модель.

12.3.1. Модель Белла и Лападула

Модель, получившая название модели Белла и Лападула (БЛМ), до сих пор оказывает огромное влияние на исследования и разработки в области компьютерной безопасности. Об этом свидетельствует огромное количество различных документов, ссылающихся в библиографии на первоначальную БЛМ. Данная модель лежит в основе построения МАС. Идеи, заложенные в БЛМ, могут быть использованы при построении различных политик безопасности.

Идеи, лежащие в основе БЛМ, берут происхождение из “бумажного мира”. Белл и Лападула перенесли модель безопасности, принятую при работе с документами, в мир компьютерных систем. Основным наблюдением, сделанным Беллом и Лападулой, является то, что в правительстве США все субъекты и объекты ассоциируются с уровнями безопасности, варьирующимися от низких уровней (неклассифицированных) до высоких (совершенно секретных). Кроме того, они обнаружили, что для предотвращения утечки информации к неуполномоченным субъектам этим субъектам с низкими уровнями безопасности не позволяется читать информацию из объектов с высокими уровнями безопасности. Это ведет к первому правилу БЛМ.

Простое свойство безопасности, также известное как правило “нет чтения вверх” (NRU), гласит, что субъект с уровнем безопасности $x_s$ может читать информацию из объекта с уровнем безопасности $x_o$, только если xs преобладает над $x_0$. Это означает, что если в системе, удовлетворяющей правилам модели БЛМ, субъект с уровнем доступа секретный попытается прочитать информацию из объекта, классифицированного как совершенно секретный, то такой доступ не будет разрешен.

Белл и Лападула сделали дополнительное наблюдение при построении своей модели: в правительстве США субъектам не позволяется размещать информацию или записывать ее в объекты, имеющие более низкий уровень безопасности. Например, когда совершенно секретный документ помещается в неклассифицированное мусорное ведро, может произойти утечка информации. Это ведет ко второму правилу БЛМ.

Свойство –$\ast$, известное как правило “нет записи вниз” (NWD), гласит, что субъект безопасности xs может писать информацию в объект с уровнем безопасности xо только если xо преобладает над xs. Это означает, что если в системе, удовлетворяющей правилам модели БЛМ, субъект с уровнем доступа совершенно секретный попытается записать информацию в неклассифицированный объект, то такой доступ не будет разрешен. Введение свойства –$\ast$ разрешает проблему троянских коней, так как запись информации на более низкий уровень безопасности, типичная для троянских коней, запрещена.

Правило запрета по записи является большим упрощением некоторых реализаций БЛМ. Так, некоторые описания включают более детальное понятие типа доступа (например такие, как добавление и выполнение). Помимо этого многие модели БЛМ включают понятие дискретной защиты с целью обеспечения хорошо гранулированной защиты при сохранении всех преимуществ БЛМ.

Правила запрета по записи и чтению БЛМ отвечают интуитивным понятиям того, как предотвратить утечку информации к неуполномоченным источникам.

Рассмотрим формализацию БЛМ. Обозначим через:

$S$ – множество субъектов;

$О$ – множество объектов;

$L$ – решетка уровней безопасности;

$F$ : $S\cup O\rightarrow L$ – функция, применяемая к субъектам и объектам; данная функция определяет уровни безопасности своих аргументов в данном состоянии;

$V$ – множество состояний – множество упорядоченных пар $(F, M)$, где $M$ – матрица доступа субъектов системы к объектам.

Система представляется начальным состоянием $v_0$, определенным множеством запросов к системе R и функцией переходов $T$ : $(V\times R)\rightarrow V$ такой, что система переходит из состояния в состояние после исполнения запроса. Сформулируем определения, необходимые для доказательства основной теоремы безопасности (ОТБ), доказанной для БЛМ.

Определение 12.1. Состояние $(F, M)$ безопасно по чтению (NRU) тогда и только тогда, когда для $\forall s\in S$ и для $\forall o\in O$, $чтение \in М[s, O]\rightarrow F(s)\ge F(o)$.

Определение 12.2. Состояние $(F, M)$ безопасно по записи (NWD, $\ast$- свойство) тогда и только тогда, когда для $\forall s\in S$ и для $\forall o\in О$, $запись\in М[s, o]\rightarrow F(o)\ge F(s)$.

Определение 12.3. Состояние безопасно тогда и только тогда, когда оно безопасно по чтению и записи.

Теорема (ОТБ). Система $(V0, R, T)$ безопасна тогда и только тогда, когда состояние $v_0$ безопасно и Т таково, что для любого состояния $v$, достижимого из $v_0$ после исполнения конечной последовательности запросов из $R$, $ T(v, c) = v^\ast$, где $v = (F, M)$ и $v^\ast = (F^\ast, M^\ast)$, переходы системы ($Т$) из состояния в состояние подчиняются следующим ограничениям для $\forall s\in S$ и для $\forall o\in О$:

- если $чтение\in M^\ast[s, o]$ и $чтение \notin M[s, o]$, то $F^\ast(s)\ge F^\ast(o)$;

- если $чтение\in M[s, o]$ и $F^\ast(s)\lt F^\ast(o)$, то $чтение \notin M^\ast[s, o]$;

- если $запись\in M^\ast[s, o]$ и $запись\notin M[s, o]$, то $F^\ast (о)\ge F^\ast(s)$;

- если $записьin M[s, o]$ и $F(o)<F(s)$, то $запись\notin М^\ast[s, o]$.

Доказательство

- Необходимость. Предположим, система безопасна. Состояние $v_0$ безопасно по определению. Если имеется некоторое состояние $v$, достижимое из состояния $v_0$ после исполнения конечной последовательности запросов из $R$ таких, что $T(v, c) = v^\ast$, хотя $v^\ast$ не удовлетворяет одному из двух первых ограничений для $T$, то $v^\ast$ будет достижимым состоянием, но противоречащим ограничению безопасности по чтению. Если $v^\ast$ не удовлетворяет одному из двух последних ограничений для $T$, то $v^\ast$ будет достижимым состоянием, но противоречащим ограничению безопасности по записи. В любом случае система небезопасна.

- Достаточность. Предположим, что система небезопасна. В этом случае либо $v_0$ должно быть небезопасно, либо должно быть небезопасно состояние $v$, достижимое из состояния $v_0$ после исполнения конечной последовательности запросов из $R$. Если $v_0$ небезопасно – все доказано. Если $v_0$ безопасно, допустим, что $v^\ast$ – первое в последовательности запросов небезопасное состояние. Это означает, что имеется безопасное состояние $v$ такое, что $T(v, c)=v^\ast$, где $v^\ast$ – небезопасно. Но это противоречит четырем ограничениям безопасности на $T$.

Теорема доказана

Несмотря на все достоинства, оказалось, что при использовании БЛМ в контексте практического проектирования и разработки реальных компьютерных систем возникает ряд технических вопросов. Данные вопросы являются логическим следствием достоинства БЛМ – ее простоты. Проблемы возникают при рассмотрении вопросов построения политик безопасности для конкретных типов систем, то есть на менее абстрактном уровне рассмотрения. При данном рассмотрении системный компонент модели усложняется, что может привести к неадекватности БЛМ в ее классической форме. Как следствие, в мире компьютерной безопасности ведется широкая полемика по поводу применимости БЛМ для построения безопасных систем.

Рассмотрим ряд примеров критики БЛМ. Некоторые из них взяты из литературы, посвященной вопросам безопасности, другие часто включаются в техническое описание и представляют собой так называемую “обязательную критику” БЛМ.

Начнем данное рассмотрение с обсуждения проблемы, возникающей в распределенных системах, удовлетворяющих правилам БЛМ. В частности, покажем, что запрос на чтение вызывает протекание потоков информации в обоих направлениях между компонентами, что является нарушением правил модели. Затем рассмотрим проблему использования этой модели для обеспечения безопасности доверенных субъектов, которые выполняют наиболее критичные задачи в компьютерной системе. Завершим обсуждение примером описания модели, известной как система $Z$.

Удаленное чтение

В свете недавних тенденций использования распределенных конфигураций требуется рассматривать модели безопасности не только для автономных, но и для распределенных компьютерных систем (распределенная система обычно состоит из нескольких объединенных систем). Очевидным способом распространения БЛМ на распределенные системы будет назначение уровней безопасности различным компонентам и соблюдение гарантий выполнения правил-ограничений по чтению и записи.

Например, некоторым компонентам можно назначить уровни безопасности, меняющиеся от неклассифицированного до совершенно секретного уровня, и на основании принципов БЛМ синтезировать соединения между различными компонентами системы. Может показаться, что если конфиденциальному субъекту A будет разрешено чтение информации из неклассифицированного объекта B, никакая конфиденциальная информация не будет раскрыта. Но при более подробном рассмотрении реализации операции удаленного чтения снизу может быть сделано неприятное наблюдение. Операция чтения между удаленными компонентами приводит к протеканию потока информации от читаемого объекта к запросившему доступ на чтение субъекту. Данный поток является безопасным, поскольку информация не разглашается неавторизованному субъекту. Однако в распределенной кон- фигурации чтение инициируется запросом от одного компонента к другому. Такой запрос образует прохождение потока информации в неверном направлении (запись в объект с меньшим уровнем безопасности). Таким образом, удаленное чтение в распределенных системах может произойти только если ему предшествует операция записи вниз, что является нарушением правил БЛМ.

Многие исследователи рассматривают эту проблему как наиболее убедительное свидетельство неадекватности БЛМ. Однако на практике эта проблема часто является несущественной; достаточно внедрения в систему дополнительных средств обработки удаленных запросов для обеспечения того, чтобы поток информации от высокоуровневого субъекта к низкоуровневому объекту был ограничен запросом на доступ. Фактически, некоторые архитектуры предлагают отдельные компоненты, выполняющие обработку таких запросов и потока информации в распределенных системах.

Доверенные субъекты

В предыдущем описании правил БЛМ не было указано, какие субъекты должны подчиняться этим правилам. Например, компьютерные системы обычно имеют администратора, который управляет системой, добавляя и удаляя пользователей, восстанавливает функционирование после сбоев, устанавливает специальное программное обеспечение, устраняет ошибки в операционной системе или приложениях и т.п. Очевидно, что процессы, действующие в интересах таких администраторов, не могут управляться правилами БЛМ или каких–либо других моделей, не позволяющих им выполнять функции администрирования.

Это наблюдение высвечивает еще одну техническую проблему, связанную с правилами БЛМ. Можно сказать, что эти правила обеспечивают средства для предотвращения угрозы нарушения секретности для нормальных пользователей, но не говорят ничего по поводу той же проблемы для так называемых доверенных субъектов. Доверенные субъекты могут функционировать в интересах администратора. Также они могут быть процессами, обеспечивающими критические службы такие, как драйвер устройства или подсистема управления памятью. Такие процессы часто не могут выполнить свою задачу, не нарушая правил БЛМ. Неприменимость БЛМ для доверенных субъектов может быть выражена путем внесения поправки в данное ранее определение операций чтения и записи БЛМ. Но хотя это и делает определение более точным, оно нисколько не облегчает задачу для разработчика, желающего построить безопасный драйвер или утилиту поддержки работы администратора.

Одним из решений, рассматриваемых в литературе по безопасности, было предложение представлять и использовать для потока информации модель, требующую того, чтобы никакая высокоуровневая информация никогда не протекала на более низкий уровень. В данных моделях низкоуровневые пользователи не могут сделать выводы или затронуть работу высокоуровневых пользователей.

Проблема системы Z

Джон МакЛин разработал концептуальное описание системы, названной Система Z. Данное описание показывает, что система, удовлетворяющая правилам БЛМ, может иметь ряд проблем с секретностью. Система Z выражается в терминах набора субъектов и объектов, с каждым из которых связан уровень безопасности. Совокупность уровней безопасности для каждого субъекта и объекта в некоторый момент времени описывает состояние системы. Система Z удовлетворяет БЛМ, если во всех состояниях системы комбинации уровней субъектов и объектов таковы, что в этом состоянии никакой субъект не может осуществить запись вниз или чтение сверху.

Предположив, что система Z удовлетворяет условиям БЛМ, можно быть уверенным, что любая угроза секретности будет обнаружена. Однако МакЛин указал на техническую деталь, которая не очевидна в таких системах. Если в некотором состоянии секретный субъект захотел прочитать совершенно секретный объект, то до тех пор, пока система удовлетворяет БЛМ, осуществить это будет невозможно. Но МакЛин заявляет, что ничто в БЛМ не предотвращает систему от “деклассификации” объекта от совершенно секретного до секретного (по желанию совершенно секретного пользователя).

В качестве иллюстрации можно привести следующий пример. Допустим, субъект с высокой степенью доверия $A$ читает информацию из объекта, уровень классификации которого также равен А. Далее данный субъект понижает свою степень доверия до уровня $В$ ($А \gt В$). После этого он может записать информацию в файл с классификацией $В$. Нарушения БЛМ формально не произошло, но безопасность системы нарушена.

Фактически, МакЛин описал конфигурацию, в которой все субъекты могут читать и записывать любой объект путем назначения соответствующих уровней безопасности объекта перед выполнением запросов на доступ. В такой системе, которая очевидно не обеспечивает секретность информации, все состояния могут быть рассмотрены как удовлетворяющие требованиям БЛМ.

Все описанное выше является справедливым для модели БЛМ в “ее классической формулировке”, кочующей из книги в книгу и из статьи в статью. Но в оригинальной модели, представленной авторами, было введено требование сильного и слабого спокойствия. Данные требования снимают проблему Z–системы. Рассмотрим их.

Правило сильного спокойствия гласит, что уровни безопасности субъектов и объектов никогда не меняются в ходе системной операции. Реализовав это правило в конкретной системе, можно легко сделать заключение, что описанный выше тип потенциальных проблем никогда не произойдет. Очевидным недостатком такой реализации в системе является потеря гибкости при выполнении операций.

Правило слабого спокойствия гласит, что уровни безопасности субъектов и объектов никогда не меняются в ходе системной операции таким образом, чтобы нарушить заданную политику безопасности. Это правило может потребовать, чтобы субъекты и объекты воздерживались от действий в период времени, когда меняются их уровни безопасности. Например, может потребоваться, чтобы уровень безопасности объекта никогда не менялся в то время, как к нему обращается некоторый субъект. Однако, если операция чередуется с изменением уровня безопасности, не вызывающего нарушения безопасности (например, субъект повышает свой уровень с секретного до совершенно секретного в ходе выполнения операции чтения некласифицированного объекта), то правило слабого спокойствия будет попрежнему соблюдено.

Фактически система Z описывает алгебру моделей, самой строгой из которых (основание) является БЛМ с сильным спокойствием (ни один субъект модели не может изменить свою классификацию), а самой слабой (вершина) - БЛМ в классической формулировке, без ограничений для субъектов на изменение классификации.

12.4. Специализированные модели

Как было отмечено в предыдущем параграфе, одним из недостатков, являющимся логическим следствием достоинства простоты БЛМ, является ее слишком большая абстрактность. С точки зрения требований пользователей, в реальных приложениях ограничения, накладываемые БЛМ, оказываются слишком строгими. Введение в модель доверенных процессов, позволяющих частично решить данную проблему, не является достаточным. С другой стороны, недостатком БЛМ, не рассмотренным нами ранее, является отсутствие в модели поддержки многоуровневых объектов (например, наличие несекретного параграфа в секретном файле данных) и отсутствие зависящих от приложения правил безопасности. С целью устранения данных недостатков при проектировании системы передачи военных сообщений(MMS) Лендвером и МакЛином была разработана модель MMS.

正如上一段所述,BLM 简单性优点的逻辑后果之一就是它过于抽象。 从用户需求的角度来看,在实际应用中BLM的限制过于严格。 在模型中引入可信流程来部分解决这个问题是不够的。 另一方面,我们之前没有考虑到的 BLM 的缺点是模型中缺乏对多级对象的支持(例如,秘密数据文件中存在未分类的段落)并且缺乏依赖于应用程序的安全规则。 为了在设计军事消息系统(MMS)时消除这些缺点,Lendwehr 和 McLean 开发了 MMS 模型。

12.4.1. Модель MMS

В модели MMS используются следующие понятия.

MMS 模型使用以下概念。

Классификация – обозначение, накладываемое на информацию, отражающее ущерб, который может быть причинен неавторизованным доступом; включающее уровни: TOP SECRET, SECRET и т.д. и множество меток (“CRYPTO”, “NUCLEAR” и т.д.). Множество классификаций и отношение между ними образуют решетку.

分类 – 适用于反映未经授权访问可能造成损害的信息的名称; 包括级别:绝密、秘密等。 和许多标签(“CRYPTO”、“NUCLEAR”等)。 分类集以及它们之间的关系形成了一个网格。

Степень доверия пользователю – уровень благонадежности персоны. Каждый пользователь имеет степень доверия, и операции, производимые системой для данного пользователя, могут проверить степень доверия пользователю и классификацию объектов, с которыми он оперирует.

用户信任度 – 人的可信度水平。 每个用户都有一定的信任度,系统对给定用户执行的操作可以验证用户的信任度以及他操作的对象的类别。

Пользовательский идентификатор – строка символов, используемая для того, чтобы отметить пользователя системы. Для использования системы пользователь должен предъявить ей пользовательский идентификатор, и система должна провести аутентификацию пользователя. Данная процедура называется login. Каждый пользователь должен иметь уникальный идентификатор.

用户ID是用于识别系统用户的一串字符。 要使用该系统,用户必须向系统提供用户ID,并且系统必须对用户进行身份验证。 此过程称为登录。 每个用户必须有一个唯一的 ID。

Пользователь - персона, уполномоченная для использования системы.

用户是被授权使用该系统的人。

Роль – работа, исполняемая пользователем (например, пользователь, имеющий право удалять, распространять или понижать классификацию объектов). Пользователь всегда ассоциирован как минимум с одной ролью в некоторый момент времени, и он может менять роль в течение сессии. Для действий в данной роли пользователь должен быть уполномочен. Некоторые роли могут быть связаны только с одним пользователем в данный момент времени (например, распространитель). С любой ролью связана способность выполнения определенных операций.

角色 – 由用户执行的作业(例如,有权删除、分发或降级对象的用户)。 用户始终一次至少与一个角色关联,并且可以在会话期间更改角色。 用户必须被授权才能扮演此角色。 某些角色一次只能与一个用户关联(例如,分销商)。 与任何角色相关的是执行某些操作的能力。

Объект – одноуровневый блок информации. Это минимальный блок информации в системе, который имеет классификацию. Объект не содержит других объектов, он не многоуровневый.

对象是单级信息块。 这是系统中具有分类的最小信息块。 一个对象不包含其他对象,它不是多级的。

Контейнер – многоуровневая информационная структура. Имеет классификацию и может содержать объекты (каждый со своей классификацией) и (или) другие контейнеры. Файл – это контейнер. Некоторые структуры файла могут быть контейнерами. Различие между объектом и контейнером базируется на типе, а не на текущем содержимом: если один из файлов данного типа является контейнером, то все остальные файлы данного типа являются контейнерами, даже если некоторые из них содержат только объекты или пусты. Устройства такие, как диски, принтеры, ленты, сетевые интерфейсы и пользовательские терминалы - контейнеры.

容器是一个多层次的信息结构。 具有分类并且可以包含对象(每个对象都有自己的分类)和(或)其他容器。 文件是一个容器。 某些文件结构可以是容器。 对象和容器之间的区别基于类型,而不是当前内容:如果给定类型的文件之一是容器,则该类型的所有其他文件都是容器,即使其中一些文件仅包含对象或为空。 磁盘、打印机、磁带、网络接口和用户终端等设备都是容器。

Сущность – Объект или Контейнер.

实体 – 对象或容器。

Требование Степени Доверия Контейнеров – атрибут некоторых контейнеров. Для некоторых контейнеров важно требовать минимум степени доверия, то есть пользователь, не имеющий соответствующего уровня благонадежности, не может просматривать содержимое контейнера. Такие контейнеры помечаются соответствующим атрибутом (CCR). Например, пользователь, имеющий степень доверия CONFIDENTAL, не может просматривать CONFIDENTAL параграф сообщения, помеченного TOP SECRET, если оно содержится в CCR контейнере. Если пользователь должен иметь возможность просматривать данное сообщение, контейнер не должен быть помечен как CCR.

容器信任度要求是某些容器的属性。 对于某些容器,要求最低程度的信任非常重要,这意味着不具有适当可信级别的用户无法查看容器的内容。 此类容器标有适当的属性 (CCR)。 例如,如果标记为“绝密”的消息包含在 CCR 容器中,则具有 CONFIDENTAL 信任级别的用户无法查看该消息的 CONFIDENTAL 段落。 如果用户必须能够查看此消息,则容器不应标记为 CCR。

Идентификатор (ID) – имя сущности без ссылки на другие сущности, например, имя файла есть идентификатор этого файла. Обычно все сущности имеют идентификатор.

标识符(ID) – 实体的名称,不引用其他实体,例如文件名是该文件的标识符。 通常,所有实体都有一个标识符。

Ссылка на сущность Прямая, если это идентификатор Сущности.

如果它是实体标识符,则引用实体直接。

Ссылка на сущность Косвенная, если это последовательность двух или более имен Сущностей (из которых только первая – идентификатор). Пример – “текущее сообщение, первый абзац, вторая строка”.

引用实体间接如果它是两个或多个实体名称的序列(其中只有第一个是标识符)。 示例 - “当前消息,第一段,第二行”。

Операция – функция, которая может быть применена к сущности. Она может позволять просматривать или модифицировать сущность. Некоторые операции могут использовать более одной сущности (пример – операция копирования).

操作是可以应用于实体的函数。 它可以允许查看或修改实体。 某些操作可能会使用多个实体(复制操作就是一个例子)。

Множество Доступа – множество троек (Пользовательский Идентификатор или Роль, Операция, Индекс операнда), которые связаны с сущностью. Операция, которая может быть специфицирована для особых сущностей, зависит от типа данной сущности. Если операция требует более одного операнда, индекс операнда специфицирует позицию, на которой ссылка на данный операнд может появиться в операции.

访问集 – 与实体关联的一组三元组(用户标识符或角色、操作、操作数索引)。 可以为特殊实体指定的操作取决于实体的类型。 如果一项运算需要多个操作数,则操作数索引指定对给定操作数的引用可以出现在运算中的位置。

Сообщение – особый тип, реализуемый в MMS. Сообщение является контейнером. Сообщение включает поля Куда, Откуда, Время, предмет, текст, автор. Чертежные сообщения включают поле чертежа.

消息是彩信中实现的一种特殊类型。 消息是一个容器。 该消息包括字段“收件人”、“发件人”、“时间”、“主题”、“文本”、“作者”。 绘图消息包括绘图字段。

Неформальная модель MMS

非正式彩信模式

Пользователь получает доступ к системе только после прохождения процедуры login. Для этого пользователь предоставляет системе Пользовательский идентификатор, и система производит аутентификацию, используя пароли, отпечатки пальцев или другую адекватную технику. После успешного прохождения аутентификации Пользователь запрашивает у системы Операции для использования функций системы. Операции, которые Пользователь может запросить у системы, зависят от его ID или Роли, для которой он авторизован: с использованием Операций Пользователь может просматривать или модифицировать Объекты или Контейнеры. Система реализует ограничения, описанные ниже.

用户只有在完成登录程序后才能访问系统。 为此,用户向系统提供用户 ID,系统使用密码、指纹或其他适当的技术执行身份验证。 认证成功后,用户向系统请求操作以使用系统功能。 用户可以从系统请求的操作取决于他的 ID 或他被授权的角色:使用操作,用户可以查看或修改对象或容器。 系统实施下述限制。

Предположения безопасности

安全假设

Пользователь всегда может скомпрометировать информацию, к которой он имеет законный доступ. Таким образом, надо сформулировать предположения безопасности, которые могут быть выполнены только пользователями системы.

用户总是可以泄露他可以合法访问的信息。 因此,有必要制定只能由系统用户满足的安全假设。

А1. Офицер безопасности системы присваивает уровни доверия, классификацию устройств и множества ролей корректно.

А2. Пользователь вводит корректную классификацию, когда изменяет, объединяет или переклассифицирует информацию.

А3. Пользователь классифицирует сообщения и определяет множества доступа для сущностей, которые он создает, так, что только пользователь с требуемой благонадежностью может просматривать информацию.

А4. Пользователь должным образом контролирует информацию объектов, требующих благонадежности.

A1。 系统安全官员正确分配信任级别、设备分类和多个角色。

A2。 用户在更改、合并或重新分类信息时输入正确的分类。

A3。 用户对消息进行分类并为其创建的实体定义访问集,以便只有具有所需可信度的用户才能查看信息。

A4。 用户对需要可信的对象的信息进行适当的控制。

Ограничения безопасности 安全限制

Ограничения безопасности, в отличие от предположений безопасности, должны поддерживаться не пользователями системы, а непосредственно компьютерной системой.

与安全假设不同,安全约束必须不是由系统用户支持,而是由计算机系统本身支持。

B1. Авторизация – пользователь может запрашивать операции над сущностями, только если пользовательский идентификатор или текущая роль присутствуют во множестве доступа сущности вместе с этой операцией и со значением индекса, соответствующим позиции операнда, в которой сущность относят в требуемой операции.

B2. Классификационная иерархия – классификация контейнера всегда больше или равна классификации сущностей, которые он содержит.

B3. Изменения в объектах – информация, переносимая из объекта, всегда наследует классификацию данного объекта. Информация, вставляемая в объект, должна иметь классификацию ниже классификации этого объекта.

B4. Просмотр – пользователь может просматривать (на некотором устройстве вывода) только сущности с классификацией меньше, чем классификация устройства вывода и степень доверия к пользователю (данное ограничение применяется к сущностям, адресуемым прямо или косвенно).

B5. Доступ к контейнерам, требующим степени доверия – пользователь может получить доступ к косвенно адресованной сущности внутри контейнера, требующего степени доверия, только если его степень доверия не ниже классификации контейнера.

B6. Преобразование косвенных ссылок – пользовательский идентификатор признается законным для сущности, к которой он обратился косвенно, только если он авторизован для просмотра этой сущности через ссылку.

B7. Требование меток – сущности, просмотренные пользователем, должны быть помечены его степенью доверия.

B8. Установка степеней доверия, ролей, классификации устройств – только пользователь с ролью офицера безопасности системы может устанавливать данные значения. Текущее множество ролей пользователя может быть изменено только офицером безопасности системы или самим пользователем.

B9. Понижение классификации информации – никакая классифицированная информация не может быть понижена в уровне своей классификации, за исключением случая, когда эту операцию выполняет пользователь с ролью “пользователь, уменьшающий классификацию информации”.

В10. Уничтожение информации – операция уничтожения информации проводится только пользователем с ролью “пользователь, уничтожающий информацию”.

B1。 授权 - 仅当用户 ID 或当前角色与该操作一起存在于实体的访问集中,并且具有与实体包含在请求的操作中的操作数位置相对应的索引值时,用户才可以请求对实体的操作。

B2。 分类层次结构 - 容器的分类始终大于或等于其包含的实体的分类。

B3。 对象的更改 - 从对象传输的信息始终继承该对象的分类。 插入到对象中的信息的分类必须低于该对象的分类。

B4。 浏览 - 用户只能(在某些输出设备上)查看分类小于输出设备分类和用户信任的实体(此限制适用于直接或间接寻址的实体)。

B5。 访问受信任容器 - 仅当用户的信任至少等于容器的分类时,用户才可以访问受信任容器内的间接寻址实体。

B6. 间接链接转换 - 仅当用户 ID 被授权通过链接查看该实体时,该用户 ID 才被识别为对其间接访问的实体合法。

B7. 需要标签 – 用户查看的实体必须标有其信任级别。

B8. 设置信任级别、角色、设备分类 - 只有具有系统安全官角色的用户才能设置这些值。 当前的用户角色集只能由系统安全员或用户本人更改。

B9. 降级信息 - 除非由具有“降级用户”角色的用户执行,否则不能降级任何机密信息。

B10. 信息销毁——销毁信息的操作仅由具有“信息销毁用户”角色的用户进行。

12.5. Проблемы моделей предоставления прав 权利模型的问题

Наряду с неоспоримыми достоинствами моделей предоставления прав, выражающимися в их интуитивной понятности и возможности реализации с высокой степенью точности, данные модели имеют ряд недостатков.

授予权利的模型具有不可否认的优势(表现为直观性和高精度实施的能力),但这些模型也有许多缺点。

В моделях предоставления прав возможно образование скрытых каналов утечки информации. Таким образом, несмотря на кажущуюся простоту реализации систем предоставления прав, перекрытие каналов утечки информации является нетривиальной задачей. При анализе защищенных вычислительных систем, построенных по принципу предоставления прав, необходим тщательный анализ каналов утечки информации. Для систем высокой степени доверия данный пункт отражен в требованиях к системе.

在授权模式中,有可能形成隐性的信息泄露渠道。 因此,尽管实施授予权利的系统表面上很简单,但关闭信息泄漏渠道却是一项艰巨的任务。 在分析基于授权原则的安全计算系统时,需要对信息泄露渠道进行彻底分析。 对于高信任系统,此项体现在系统需求中。

Анализ скрытых каналов утечки информации базируется обычно на принципах анализа потоков данных в программном обеспечении (данные принципы разработаны Д. Деннинг), контроля совместно используемых ресурсов, которые могут быть применены для организации скрытых каналов утечки информации (каналы утечки информации на основе хранения) и использования программами таймеров (временные каналы утечки информации).

信息泄漏隐藏通道的分析通常基于软件中数据流分析的原理(这些原理由D. Denning提出)、可用于组织信息泄漏隐藏通道的共享资源的控制(基于存储的信息泄漏通道)和程序定时器的使用(信息泄漏的临时通道)。

Хотя каналы утечки информации нетрудно обнаружить, их обычно находят уже после того, как система синтезирована. Как следствие, их ликвидация может быть затруднительна.

虽然信息泄漏通道并不难检测,但通常是在系统综合后才发现的。 因此,消除它们可能很困难。

12.6. Информационные модели

Информационные модели определяют ограничения на отношение ввода/вывода системы, которые достаточны для реализации системы. Данные модели накладывают ограничения на интерфейс программных модулей системы с целью достижения безопасной реализации. При этом подробности реализации определяются разработчиком системы. Данные модели являются результатом применения теории информации к проблеме безопасности систем. К информационным моделям относятся модели невмешательства и невыводимости. Достоинствами данного типа моделей, в отличие от моделей предоставления прав, являются:

- отсутствие в них скрытых каналов утечки информации;

- естественность их использования для реализации сетевых защищенных вычислительных систем.

Теория данных математических моделей бурно развивается в настоящее время.

12.6.1. Модель невмешательства

Невмешательство - ограничение, при котором ввод высоко уровневого пользователя не может смешиваться с выводом низкоуровневого пользователя.

Модель невмешательства рассматривает систему, состоящую из четырех объектов: высокий ввод (high–in), низкий ввод (low–in), высокий вывод (high– out), низкий вывод (low–out).

Рассмотрим систему, вывод которой пользователю u определен функцией out(u, hist.read(u)), где hist.read(u) – история ввода системы (traces), чей последний ввод был read(u) (команда чтения, исполненная пользователем u). Для определения безопасности системы необходимо определить термин очищения (purge) историй ввода, где purge удаляет команды, исполненные пользователем, чей уровень безопасности не доминирует над уровнем безопасности u. Функция clearence(u) – определяет степень доверия к пользователю

Определение: purge – функция $users \times traces \rightarrow traces$ такая, что:

purge(u, <>) = <>, где о - пустая история ввода;purge(u, hist.command(w)) = purge(u, hist.command(w)), еслиcommand(w)– ввод, выполненный пользователемw;clearence(u)≥clearence(w);purge(u, hist.command(w)) = purge(u, hist), еслиcommand(w)- ввод, выполненный пользователемw;clearence(u)<clearence(w).

Система удовлетворяет требованию невмешательства, если и только если для всех пользователей u, всех историй Т и всех команд вывода с out(u,T.c(u)) = out(u,purge(u,T).c(u)).

Для того, чтобы проверить, удовлетворяет ли система требованиям невмешательства, было разработано множество условий («unwinding conditions»), выполнение которых достаточно для поддержки невмешательства в модели машины состояний. Хотя верификация модели невмешательства труднее, чем верификация БЛМ, после нее в системе не остается скрытых каналов утечки информации. Модель невмешательства ближе к интуитивному понятию безопасности, чем БЛМ.

При сравнении модели невмешательства с БЛМ можно отметить:

- БЛМ слабее, чем модель невмешательства, так как модель невмешательства запрещает многие скрытые каналы, которые остаются при реализации примитивной БЛМ.

- Модель невмешательства слабее, чем БЛМ в том, что она разрешает низкоуровневым пользователям копировать один высокоуровневый файл в другой высокоуровневый, что БЛМ запрещает, так как при этом нарушается ее безопасность по чтению.

- Было показано, что для определенных систем модель невмешательства особенно хороша в том, что если последовательность ввода

Хне смешивается с последовательностью выводаY, иХнезависима от ввода других пользователей, тоI(X, Y)=0, гдеI(X, Y)– взаимная дляХиYинформация и представляет собой поток информации отXкY.

12.6.2. Модель невыводимости

Рассмотрим модель невыводимости, также базирующуюся на рассмотрении информационных потоков в системе. Модель невыводимости выражается в терминах пользователей и информации, связанных с одним из двух возможных уровней секретности (высокий и низкий).

Система считается невыводимо безопасной, если пользователи с низкими уровнями безопасности не могут получить информацию с высоким уровнем безопасности в результате любых действий пользователей с высоким уровнем безопасности. Другими словами, в таких системах утечка информации не может произойти в результате посылки высокоуровневыми пользователями высокоуровневой информации к низкоуровневым пользователям. Интуитивно это определение относится не к информационным потокам, а к разделению информации. Однако такое определение безопасности не предохраняет информацию высокоуровневых пользователей от просмотра низкоуровневыми пользователями. Данное определение требует, чтобы низкоуровневые пользователи не были способны использовать доступную им информацию для получения высокоуровневой информации (это объясняет, почему определение названо невыводимостью).

Многие исследователи предложили рассматривать понятие посылки и интерпретации сигнала шире, чем понятия чтения и записи в модели БЛМ. Иными словами, чтение и запись рассматриваются в контексте этой модели как явные операции, вызываемые пользователями компьютерной системы, и выполняются определенной автоматизированной последовательностью вычислительных действий. Поскольку определение невыводимости, данное выше, неформально, то обычно появляется необходимость представить понятие невыводимости в более строгой форме. Это делается во избежание двусмысленности или других ошибок. Поэтому рассмотрим это понятие, используя модель машины состояний с ограниченными атрибутами, как средство для более точного определения невыводимости. В частности, машина состояний будет обладать детерминированным поведением и состоять из следующих частей:

- набор пользователей с высоким или низким уровнем безопасности;

- набор возможных последовательностей системных вводов информации от пользователей и выходных реакций системы.

Допустим, что машина принимает ввод от высоко– и низкоуровневых пользователей, обрабатывает эти вводы некоторым незаданным образом и затем выдает на выходах к высоко– и низкоуровневым пользователям информацию. Возможно также, что вводят информацию и получают данные вывода одни и те же пользователи. Единственным различием пользователей является то, какой у них уровень безопасности – высокий или низкий.

Если множество вводов от пользователей в машину связано со множеством выводов, получаемых пользователями от машины каким-либо разумным образом (возможно, основываясь на времени их поступления), то тогда можно рассматривать выходную последовательность как трассировку (traces, см. модель невмешательства) системы. Безопасность невыводимости может быть определена в соответствии со множеством всех трассировок системы и множеством вводов и выводов, видимых пользователями.

Точнее, система может быть признана невыводимо безопасной, если для каждой метки безопасности х и определенной трассировки есть вторая трассировка, показывающая то же поведение, видимое пользователями с меткой безопасности меньшей или равной х, но не имеющая вводов не меньших или равных х. Другими словами, высокоуровневые вводы могут всегда быть удалены из трассировки и это не повлияет на то, что видят низкоуровневые пользователи. Можно заметить, что понятие невыводимости не охватывает ситуаций, основанных на концепции “интерпретации информации” в той степени, в которой этого можно было ожидать. Данный недостаток устраняется с помощью ограничения понятия составляющих вводов и выводов модели.

Например, предположим, что некоторая система принимает вводы и обеспечивает выводы для множества высоко- и низкоуровневых пользователей.

Каждый пользователь связан с определенным взглядом на систему (например, видимые вводы и выводы) и может получить информацию, интерпретируя видимое ему поведение. Если система является невыводимо безопасной, то низкоуровневые пользователи не должны получить новой информации, если на вводе системы есть дополнительные высокоуровневые пользователи. Кроме этого, если низкоуровневые пользователи могут получить определенную информацию, основываясь на видимом ими поведении, то удаление высокоуровневых пользователей не должно изменить получаемой низкоуровневыми пользователями информации.

12.7. Вероятностные модели

Модели этого типа исследуют вероятность преодоления системы защиты за определенное время Т. К достоинствам моделей данного типа можно отнести числовую оценку стойкости системы защиты. К недостаткам – изначальное допущение того, что система защиты может быть вскрыта. Задача модели данного типа – минимизация вероятности преодоления системы защиты.

12.7.1. Игровая модель

Игровая модель системы защиты строится по следующему принципу. Разработчик создает первоначальный вариант системы защиты. После этого злоумышленник начинает его преодолевать. Если к моменту времени Т, в который злоумышленник преодолел систему защиты, у разработчика нет нового варианта, система защиты преодолена. Если нет – процесс продолжается. Данная модель описывает процесс эволюции системы защиты в течение времени.

12.7.2.Модель системы безопасности с полным перекрытием

Система, синтезированная на основании модели безопасности с полным перекрытием, должна иметь по крайней мере одно средство для обеспечения безопасности на каждом возможном пути проникновения в систему (рис.12.1.).

Рис. 12.1. Модель системы защиты с полным перекрытием

В модели точно определяется каждая область, требующая защиты, оцениваются средства обеспечения безопасности с точки зрения их эффективности и их вклад в обеспечение безопасности во всей вычислительной системе. Считается, что несанкционированный доступ к каждому из набора защищаемых объектов О сопряжен с некоторой величиной ущерба, и этот ущерб может быть определен количественно.

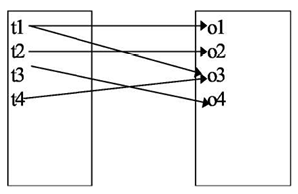

С каждым объектом, требующим защиты, связывается некоторое множество действий, к которым может прибегнуть злоумышленник для получения несанкционированного доступа к объекту. Можно попытаться перечислить все потенциальные злоумышленные действия по отношению ко всем объектам безопасности для формирования набора угроз Т, направленных на нарушение безопасности. Основной характеристикой набора угроз является вероятность проявления каждого из злоумышленных действий. В любой реальной системе эти вероятности можно вычислить с ограниченной степенью точности.

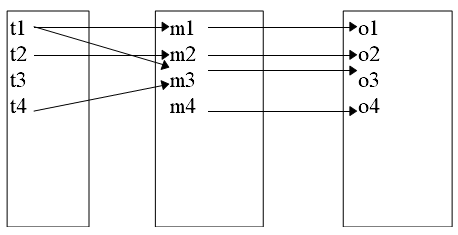

Рассмотрим более строгое описание вероятностной модели, построенное на основе теории множеств. Множество отношений объект– угроза образуют двухдольный граф (рис. 12.2.), в котором ребро $\langle t_i\ o_j\rangle$ существует тогда и только тогда, когда $t_i$ ($\forall t_i\in T$) является средством получения доступа к объекту $о_i$ ($\forall o_J\in O$). СВЯЗЬ между объектами и угрозами типа “один ко многим”, то есть одна угроза может распространяться на любое число объектов и объект может быть уязвим со стороны более чем одной угрозы. Цель защиты состоит в том, чтобы перекрыть каждое ребро графа и воздвигнуть барьер для доступа по этому пути.

Рис. 12.2. Граф объект – угроза